Comment réinventer le rôle des managers à l’ère de l’IA ?

Par Alex Hoffmann

Quatre-vingt-quinze pour cent d’échec, c’est le taux d’échec des projets d’IA générative qui n’atteignent jamais la production, selon une étude du MIT publiée en juillet 2025. Un naufrage silencieux qui se joue dans les comités de direction, loin des annonces triomphantes des éditeurs de logiciels. Pourtant, dans le même temps, quatre-vingt-seize pour cent des organisations prévoient d’accroître leur utilisation des agents d’IA dans les douze prochains mois. Ce paradoxe révèle une vérité brutale : l’IA agentique n’échoue pas pour des raisons techniques, mais parce que les entreprises persistent à l’aborder avec des réflexes managériaux obsolètes.

Les limites d’un modèle

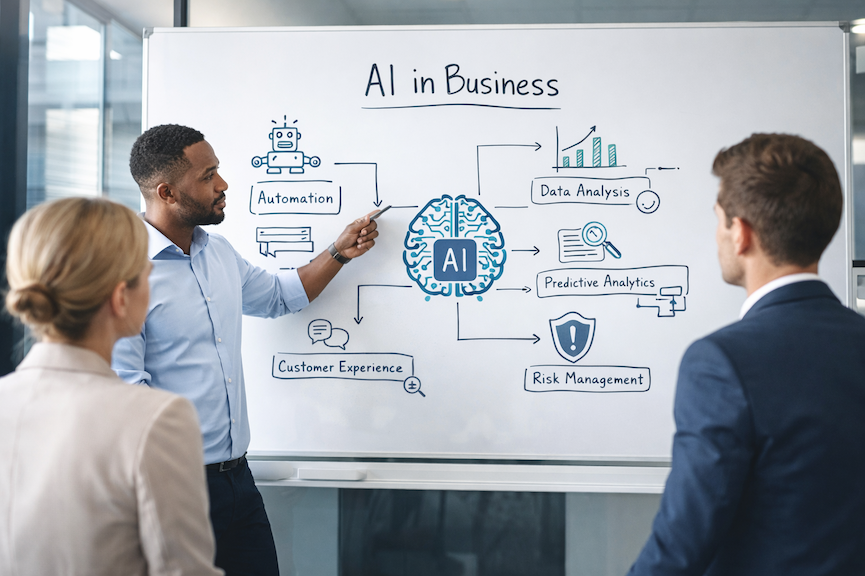

L’IA agentique désigne des systèmes capables de percevoir leur environnement, de raisonner, de planifier et d’agir de manière autonome pour atteindre des objectifs définis. Stanislas Polu, fondateur de Dust, le résume sans détour : un agent est un programme dont les décisions sont prises par un modèle de langage, non plus par des développeurs qui écrivent des règles. Cette autonomie change fondamentalement la donne managériale. Lorsqu’un agent peut automatiquement extraire les actions d’un appel client et les injecter dans Salesforce, analyser des milliers de textes juridiques pour adapter des brevets internes, ou encore réconcilier les déclarations de congés maladie avec les retours de la sécurité sociale, le rôle du manager bascule du contrôle opérationnel vers une fonction bien plus stratégique : l’orchestration d’équipes hybrides. Cette mutation exige des compétences radicalement nouvelles.

La figure du superviseur ou du manager, qui assigne et contrôle des tâches à des êtres humains, se heurte aux limites de son modèle face à des entités qui fonctionnent 24 heures sur 24 et avec une capacité d’analyse quantitative surhumaine. Les compétences émergentes sont moins liées au contrôle. L’orchestration devient la compétence cardinale, celle qui permet de coordonner des équipes où humains et agents collaborent dans des workflows complexes.

Un directeur marketing ne rédige plus uney brief, il définit un objectif stratégique, « augmenter de 15 % l’acquisition de clients sur le segment Y d’ici au trimestre prochain » et orchestre un écosystème d’agents : l’un analyse les données comportementales en temps réel, un autre génère et A/B teste des centaines de créations publicitaires, un troisième optimise les enchères publicitaires. Le manager passe du statut de chef d’orchestre, qui connaît chaque note, à celui de compositeur, qui définit la partition et harmonise les instruments. Cette supervision d’agents requiert une nouvelle littératie : comprendre leurs capacités, mais aussi leurs angles morts, leurs biais potentiels et leurs limites décisionnelles dans des contextes imprévus.

Sarah Chen, directrice de l’innovation dans un groupe industriel, confie : « Au début, mon équipe voyait ‘Orion’, notre agent d’analyse prédictive, comme une menace. Puis, en le voyant modéliser en trois heures des scénarios qui nous prenaient trois semaines, la peur a cédé la place à une curiosité. Nous avons dû apprendre à lui poser les bonnes questions. La collaboration est devenue une danse : l’IA propose des options, nous apportons le contexte, l’intuition et le jugement éthique. » À l’inverse, Marc Lemoine, responsable commercial, témoigne d’une résistance plus sourde : « Mon agent de gestion de la relation client est d’une efficacité redoutable pour prioriser mes appels. Mais il ne sent pas la tension chez un prospect, il ne perçoit pas le non-dit. Je dois constamment ‘désautomatiser’ ses recommandations. C’est un collègue qui ne comprendra jamais la complexité humaine. » Ces récits illustrent le cœur du problème : le défi n’est pas technologique, mais organisationnel et culturel.

Face à cette mutation, le leadership doit évoluer. Le dirigeant de demain ne sera pas un simple gestionnaire de ressources humaines ou technologiques. Il deviendra un architecte d’intelligence collective, capable de concevoir des environnements où humains et agents IA co-apprennent, co-décident et co-créent de la valeur.

Cette vision implique une transformation profonde de la culture managériale. Elle suppose de passer d’une logique de contrôle à une logique de collaboration, d’ouvrir des espaces d’expérimentation, de favoriser l’apprentissage croisé. Mais cette transition ne se décrète pas, elle se construit, pas à pas, à partir de cas concrets. Le premier pilote, la première équipe, le premier agent IA intégré dans un processus réel : voilà le point de départ. C’est dans ces micro-expériences que se joue l’avenir. Elles permettent de tester, d’ajuster, de comprendre les impacts humains, opérationnels, éthiques. Elles offrent aux dirigeants une opportunité unique : celle de façonner activement la collaboration homme-machine, au lieu de la subir car la question n’est plus de savoir si vous accueillerez un collègue IA, mais comment vous allez le faire.

Mais cette transition ne se décrète pas, elle se construit L’IA agentique n’est pas une menace lointaine. Elle est déjà là, dans les outils que vous utilisez, dans les plateformes que vous déployez, dans les attentes de vos clients et de vos collaborateurs. Elle redéfinit les contours du travail, les formes de l’intelligence, les équilibres organisationnels et elle vous invite à un choix : subir ou construire. Le dirigeant éclairé choisira la construction. Il initiera des pilotes, mobilisera ses équipes et repensera ses modèles. Et dans cette partition nouvelle, l’agent IA ne sera pas un intrus, mais un collègue virtuellement présent dans l’open space de votre entreprise.

Retrouvez l’ensemble de nos articles Gestion d’Entreprises